:quality(80)/bucket-prod.jecreemavitrine.fr/uploads/sites/165/2019/04/16ae76fc9df0a1acad7951117d98f971-1453372194.jpeg)

La Uncanny Valley ou les fausses notes de l’IA

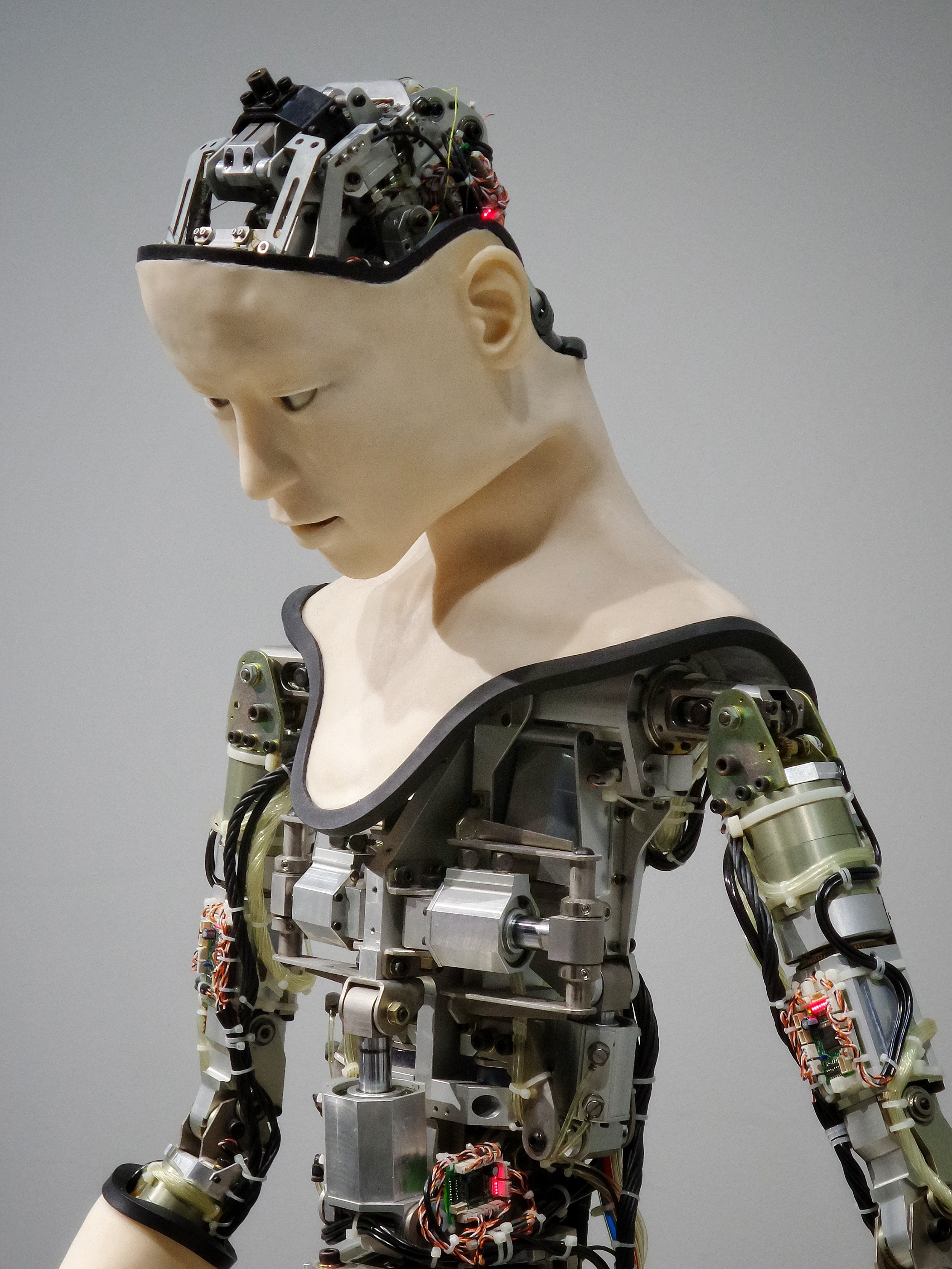

Qui n’a jamais ressenti cette légère gêne ou inconfort à la vue et/ou à l’écoute d’une intelligence artificielle se rapprochant d’un comportement humain mais pas suffisamment pour tromper notre encéphale ? Plus communément désignée comme Uncanny Valley – nous l’évoquions dans un précédent Moulin à Paroles – cette notion renvoie à la dissonance cognitive provoquée par une telle interaction.

Les exemples sont évidemment nombreux et tendent à se multiplier en même temps que les devices connectées, robots et films d’animation pour ne citer que ceux là.

Une notion consacrée depuis près d’un demi-siècle

La théorie même de Uncanny Valley – car il s’agit d’une théorie scientifique – a été consacrée par le roboticien japonais Masahiro Mori en 1970. Elle renvoyait alors aux premières formes d’intelligence artificielle ayant été pensées et conçues pour restituer l’apparence physique humaine. Or, les premiers cas ont vite mis en lumière le fait que plus celles-ci étaient similaires à un être humain, plus les approximations qui les différenciaient de nous étaient perçues par notre inconscient.

Cette perception se traduit par une gêne. Or, celle-ci ne survient pas lorsque l’utilisateur est confronté à une intelligence artificielle qui présente une vague forme humanoïde, qu’elle soit visuelle ou auditive. On constate même l’effet inverse car les quelques traits perçus comme humains auront une déclencheront un sentiment d’empathie. En revanche, dès lors que les traits physiques, le ton ou l’intonation deviennent trop humains, l’effet inverse se produit. Il est dû à la dissonance cognitive, soit la tension qui réside entre les cognitions (les croyances, émotions ou attitudes) du fait qu’elles commencent à s’opposer.

Une théorie empruntée à la psychologie

Aussi, le terme de Uncanny Valley n’a pas été choisi au hasard, d’abord emprunté au terme freudien unheimlich, soit « inquiétante étrangeté ». Dans un second temps ce concept a été verbalisé comme celui d’extimité puis mis en image.

Le sentiment d’étrangeté (Uncanny) ressenti à ce moment précis doit être surmonté ou franchi (comme on franchirait une vallée) pour aller vers plus de progrès technologique. C’est pourquoi ce rejet instinctif doit donner lieu in fine à plus d’acceptation de ces différences. On peut d’ailleurs percevoir une représentation de la vallée sur le schéma, elle n’est autre que la zone de perception négative ressentie par l’utilisateur ou observateur.

Une autre théorie, nettement plus macabre veut que notre perception d’une intelligence artificielle trop humanoïde pour l’être suffisamment soit la même que nous ressentons à la vue d’un corps ou d’une personne gravement malade. À la différence près que nous ne sommes tenus à aucune règle de bienséance ou de respect élémentaire à la vue d’une intelligence artificielle.

La Uncanny Valley rapportée au vocal

Les exemples de Uncanny Valley les plus documentés portent évidemment sur des robots ou des personnages en CGI dont l’apparence physique se rapproche de celle de l’humain. Pourtant, avec l’émergence des assistants vocaux et des usages liés au vocal, plusieurs cas circulent. Ceux-ci se feront d’ailleurs de plus en plus nombreux si l’on considère que le nombre d’assistants vocaux dépassera la population mondiale d’ici 2021.

Pour l’heure, les exemples recensés ne concernent pas la voix générique des assistants puisque trop robotique. A l’inverse, il s’agit de tentatives caractérisées par une intonation, une diction et un timbre quasiment identiques à ceux de n’importe quel être humain.

Le cas Google Duplex

Depuis maintenant un an, Google Assistant peut passer un appel en lieu et place de l’utilisateur. Initialement conçu pour faire gagner du temps, l’assistant est à même de réaliser certaines actions par téléphone. Il peut ainsi faire une réservation ou commander une pizza auprès de petits établissements qui n’effectuent ces actions que par téléphone. Baptisé Google Duplex celui-ci est capable de comprendre des phrases plus complexes, une élocution plus rapide et d’effectuer des échanges plus longs.

Pourtant s’il est une chose dont Google Duplex n’est pas capable, c’est interagir avec un être humain sans tomber dans la Uncanny Valley et ce malgré le fait qu’il ait passé le test de Turing. L’interlocuteur n’étant pas informé du fait qu’il s’adresse à une intelligence artificielle, les échanges prennent vite une tournure étrange dans laquelle règne un certain malaise.

Ainsi, les « hi, uh » ou encore « um, hey » ne parviennent pas à tromper notre cerveau. La manque de confiance et les hésitations nuisent profondément à l’interaction et traduisent un manque de sociabilité flagrant de la part de l’IA. Par ailleurs, aucune plaisanterie ou acquiescement ne viennent enrichir le principe de coopération censé caractériser toute conversation humaine.

Enfin, l’IA est dénuée de toute politesse élémentaire et n’a jamais recours au conditionnel, là où devraient se trouver des « may I », l’assistant n’a recours qu’aux « I want ».

Eviter l’écueil de la Uncanny Valley pour le vocal

Partons du principe que tenter de rendre l’assistant plus humain aboutit généralement à le rendre moins réel. La solution réside donc dans le fait de faire reconnaître ses propres limites à l’assistant. Aussi, dans le cas d’un message d’erreur, au lieu de feindre une réaction humaine du type « Pardon, je n’ai pas compris. Pouvez-vous répéter ? », il est plus indiqué d’opter pour une réponse du type « Mes capacités sont limitées et je ne peux répondre qu’à certaines questions ».

L’expression de ses propres limites par l’assistant aura pour effet de préparer l’utilisateur et d’atténuer la recherche d’un comportement humain. Toutefois, il est impossible de l’empêcher purement et simplement car cette recherche se fait inconsciemment. Ce constat fait aussi tout l’intérêt de l’UX en ce que cette discipline en appelle à des sciences transverses et nous aide à en apprendre autant sur la machine que sur nous-même.

:quality(80)/bucket-prod.jecreemavitrine.fr/uploads/sites/165/2024/08/portrait-sigismond-de-malleray-1024x1024-1.jpg)

:quality(80)/bucket-prod.jecreemavitrine.fr/uploads/sites/165/2019/05/papy.jpg)

:quality(80)/bucket-prod.jecreemavitrine.fr/uploads/sites/165/2019/03/howard-lawrence-b-707394-unsplash-1.jpg)

:quality(80)/bucket-prod.jecreemavitrine.fr/uploads/sites/165/2019/02/rahul-chakraborty-556155-unsplash.jpg)